Primeira-ministra Meloni vai testemunhar em tribunal sobre o vídeo pornográfico “deepfake”

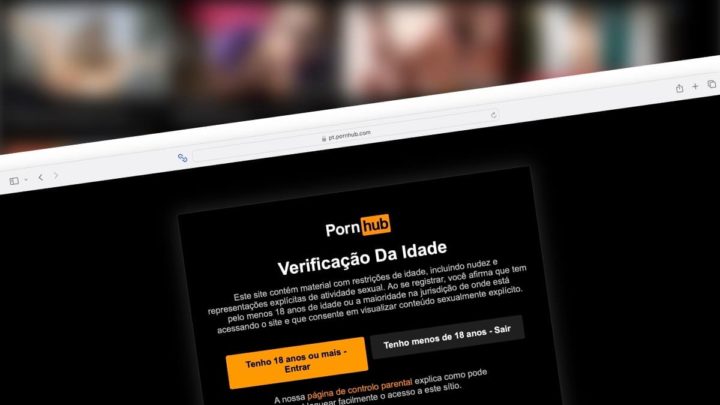

A primeira-ministra de Itália, Giorgia Meloni, vai testemunhar em tribunal num processo civil que intentou contra dois homens que alegadamente fizeram um vídeo pornográfico deepfake dela.