EUA querem que Tesla explique como verificou o Autopilot, após um “recall”

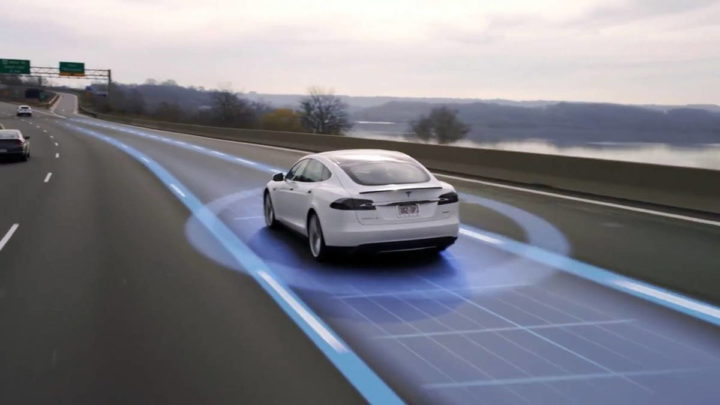

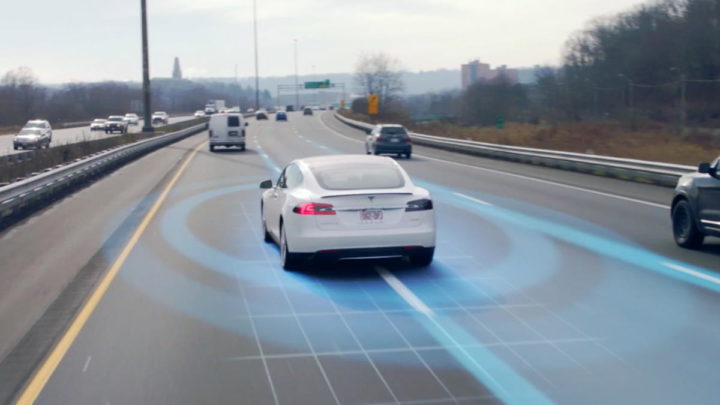

As autoridades americanas querem que a Tesla explique como desenvolveu o seu Autopilot, bem como se o "recall" que fez, em dezembro, resolveu os problemas reportados.

No final do ano passado, a Tesla atualizou, remotamente, cerca de dois milhões de veículos, após a Administração Nacional de Segurança Rodoviária americana (em inglês, NHTSA) ter dito que o seu Autopilot levantava algumas preocupações de segurança.

Agora, as autoridades querem que a Tesla explique como desenvolveu a correção do sistema de condução aplicada aquando do "recall". As preocupações recentes surgem, pois a Tesla já relatou 20 acidentes desde a atualização do software.

Numa carta destinada à Tesla, as autoridades americanas escreveram que não conseguiram encontrar uma diferença entre os avisos ao condutor para prestar atenção antes da recolha e depois de o novo software ter sido lançado.

A NHTSA disse que vai avaliar se os avisos ao condutor são adequados, especialmente quando a câmara de monitorização do condutor está tapada.

A agência terá solicitado muitas informações sobre a forma como a Tesla desenvolveu a correção, e centrou-se na forma como utilizou o comportamento humano para testar a eficácia do "recall".

É bastante claro para todos que assistem que Tesla tentou fazer o menor remédio possível para ver o que eles poderiam fazer. E a NHTSA tem de responder com força ou outras empresas de automóveis começarão a lançar soluções inadequadas.

Disse Phil Koopman, professor da Carnegie Mellon University que estuda segurança de condução automatizada, argumentando que parece que o "recall" não foi suficiente para resolver problemas com o Autopilot, tendo servido para pacificar a NHTSA, que exigiu a atualização após mais de dois anos de investigação.

Autoridades americanas desconfiam do Autopilot

As preocupações relativamente ao Autopilot da Tesla não são novas. Afinal, conforme recordado pela Associated Press, especialistas em segurança já expressam dúvidas há algum tempo. Na sua perspetiva, a tecnologia não foi projetada para operar em estradas que não sejam rodovias de acesso limitado.

De facto, a carta que a NHTSA dirigiu à Tesla pergunta como a empresa usou a ciência do comportamento humano para projetar o Autopilot e pede que esta analise a importância de avaliar os fatores humanos.

Além disso, pede que a Tesla identifique todos os trabalhos envolvidos na avaliação do comportamento humano e as qualificações daqueles que trataram do processo. Mais, procura saber, ainda, se os cargos ainda existem.

Na opinião de Missy Cummings, professora de engenharia e computação na George Mason University, Elon Musk demitiu qualquer pessoa com conhecimento de comportamento humano.

Fê-lo, na sua perspetiva, apesar de ser uma habilidade necessária à implementação de sistemas parcialmente automatizados como o Autopilot, que não podem conduzir sozinhos e exigem que os humanos estejam prontos para intervir em todos os momentos.

Se vai ter uma tecnologia que depende da interação humana, é melhor ter alguém na sua equipa que saiba o que está a fazer nesse campo.

Podemos ter a cabeça fixa numa posição, podemos ter os olhos na estrada e podemos estar a um milhão de quilómetros de distância na nossa cabeça.

Na mesma carta dirigida à Tesla, a NHTSA pede informações sobre como a solução entregue no "recall" aborda a confusão do motorista sobre o estado do Autopilot. Antes, se o sistema fosse desativado, os condutores podiam não se aperceber imediatamente de que tinham de assumir a condução.

Com o "recall", a Tesla entregou uma funcionalidade que proporciona um "abrandamento mais pronunciado", de modo a alertar os condutores quando o Autopilot é desativado. Contudo, a solução não está predefinida, pelo que devem ser os condutores a ativá-la. Os investigadores querem saber, portanto, quantos condutores ativaram a função.

A NHTSA iniciou a sua investigação relativamente ao Autopilot em 2021, após receber 11 relatórios de que modelos da Tesla com o Autopilot ativado atingiram veículos de emergência estacionados.

Dependendo das conclusões, a agência americana pode motivar a Tesla a incluir outras soluções de segurança em novas atualizações; limitar os locais onde o Autopilot pode funcionar; ou até forçar a fabricante a desativar o sistema até que esteja corrigido.

Este artigo tem mais de um ano

O Musk é um trafulha. XD