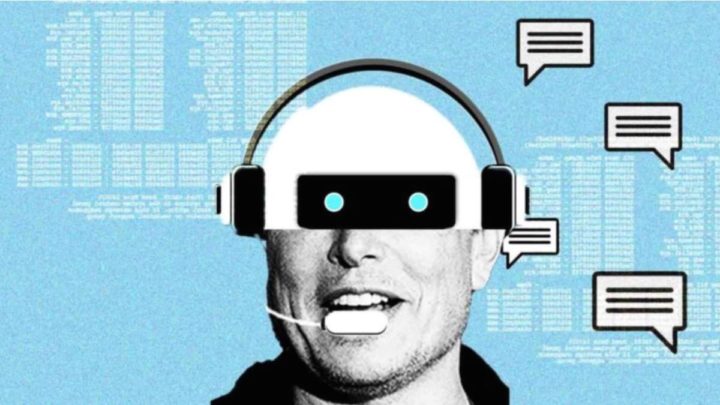

Elon Musk diz que quem pensa que não há riscos na Inteligência Artificial é um idiota

A Inteligência Artificial tem sido o tema mais quente nas notícias do mundo tecnológico. Para além dos vários serviços e soluções em que esta tecnologia está integrada, temos também as preocupações de várias empresas e personalidades ligadas ao setor. Recentemente, Elon Musk disse que quem pensa que não há riscos na IA é um idiota.

A polémica está instalada entre aqueles que defendem e que se opõem à evolução da Inteligência Artificial. Elon Musk é um dos defensores da teoria de que deve haver cautela neste setor devido aos vários perigos que esta tecnologia pode trazer. Nesse sentido, no final do mês de março, o CEO da Tesla, assim como outros nomes populares, assinaram uma carta aberta para travar os sistemas IA.

Elon Musk diz que quem acha que não há riscos na IA é idiota

Recentemente, o magnata dos carros elétricos deu uma entrevista ao programa Tucker Carlson Tonight, da Fox News, onde afirma que que a Inteligência Artificial tem o potencial de destruir a civilização. Depois, em resposta a essa publicação na rede social Twitter, Elon Musk deixou claro que quem considera que este risco é de 0% é um idiota.

Anyone who thinks this risk is 0% is an idiot

— Elon Musk (@elonmusk) April 15, 2023

Na entrevista, Musk explica que a IA é mais perigosa do que um projeto de aeronave mal gerido ou a produção de um carro mal feito, uma vez que pode então ter o potencial de destruir a civilização, mesmo que essa probabilidade seja pequena.

Portanto, no fundo o alerta é para a utilização que será dada à IA, uma vez que não existem regulamentos e muitos países já estão a explorar esta tecnologia para fins militares e para ataques cibernéticos. Mas, por outro lado, Elon Musk criou recentemente a X.AI, a sua empresa dedicada à Inteligência Artificial.

Anteriormente a Europol disse que o serviço ChatGPT pode facilitar a criminalidade e este sistema já foi mesmo banido em Itália. Para além disso, estima-se que a IA afete 300 milhões de empregos num futuro próximo.

Este artigo tem mais de um ano

Ele conseguiu pensar isso sozinho?

Que génio!!!

X.AI é inofensiva. …..

O homem está nervoso chegou atrasado ao negocio

Este homem é um idiota!

A AI não oferece perigo nenhum!

Mas não foi ele que tentou comprar a empresa do ChatGPT e que como,por um qualquer motivo ou pormenor, não conseguiu disse que iria criar uma empresa do “zero” para desenvolver essa tecnologia?! Parece mais uma conversa de “ressabiado” ou de “menino mimado”…

Ele fundou a OpenAI…

E saiu quando se ofereceu para liderar a OpenAI e os outros co-fundadores não aceitaram. Preferiram outro co-fundador, Sam Altman.

Há também a questão do dinheiro que foi considerado necessário para a OpenAI: 1.000 milhões de dólares. Musk pôs 100 milhões e ainda hoje chora por eles. Quem investiu 1.000 milhões de dólares foi a Microsoft em 2019 (em janeiro passado anunciou mais 10.000 milhões).

A entrevista ao programa Tucker Carlson Tonight, da Fox News (um canal de televisão pró-Trump) é transmitida estas noite. Mas a Fox News já transmitiu alguns clips. Transcrevo parte do que foi noticiado:

“Musk considera que a I.A. é muito mais perigosa do que o design defeituoso de aeronaves ou a produção de carros ruins, pois “tem o potencial de destruição civilizacional”.

Ele acrescentou que é “irónico” que os engenheiros da OpenAI estejam agora, segundo ele, “a treinar a IA para mentir”.

Para combater esse enviesamento criado pelo ChatGPT, Musk disse a Carlson que planeia criar seu próprio sistema de IA, provisoriamente apelidado de TruthGPT [VerdadeGPT], provavelmente relacionado com a empresa de IA X.AI, com sede em Nevada, que Musk terá fundado em março.

De acordo com Musk, o TruthGPT seria uma “I. de procura-máxima da verdade que tenta entender a natureza do universo”. Musk disse que uma I.A. com a missão de entender o universo “é improvável que aniquile os humanos porque somos uma parte interessante do universo.”

Enfim, nada de novo, exceto a missão principal da IA de Musk – de entender a verdadeira natureza do universo e daí não aniquilar os humanos (se) os considerar parte interessante do universo 😉

Além (em vez) dos “sound bites” de Musk, convém dar atenção ao que diz Sam Altman, CEO da OpenAI.

Esta é uma entrevista de 16/03, na sequência do lançamento do GPT-4: https://abcnews.go.com/Technology/openai-ceo-sam-altman-ai-reshape-society-acknowledges/story?id=97897122

TruthGPT?, tá… Esses paladinos que gostam de defender a ‘sua verdade’ e tentam atirar areia para os olhos. TODOS os modelos de IA podem ter um viés. Cabe a quem os usa não se fiar completamente neles e aprofundar o seu conhecimento por outras fontes.

Os únicos que oferecem perigo são os humanos, porque IA não passa de um software que executa um modelo matemático. Agora, a quem compete saber o que elas fazem é puramente ao humanos.

Exactamente, “Os únicos que oferecem perigo são os humanos”, sobretudo os humanos que controlarem os motores de AI 😉

Disseste tudo!

Agora a frase: “Agora, a quem compete saber o que elas fazem é puramente ao humanos”, está completamente inviesada, pois os ‘humanos’, ou dito de outra forma, as organizações/governos/empresas na posse destas ferramentas representam um perigo, o verdadeiro perigo. E essas não as vais conseguir controlar. Lembras-te da crise económica de 2008? Aconteceu porque eram os bancos que se estavam a controlar a si próprios…. Até que em 2012 foram os próprios bancos a dizer que não se podiam controlar a si próprios porque eram demasiado ambiciosos. Perderam imenso dinheiro, muitos bancos faliram e foram salvos pelo erário público, mas nunca se refrearam nem refreariam pois isso implicava perdas a curto ou médio prazo para os investidores.

Queres um exemplo a nível estatal? O Irão começou a controlar as mulheres que não colocam o hijab na via pública através das câmaras e da AI. Queres também o exemplo do controlo estatal na China, através das câmaras e da AI?

E que dizer do controlo dos supermercados sobre os cidadãos que têm as suas Apps instaladas e que com isso até chegam ao controlo fino de saber por que corredores o cliente passou e quanto tempo se demorou por zona do estabelecimento?

Se aliares Big Data + AI + interfaces de controlo colocas meia dúzia de macacos a controlar a população mundial, e nem os regimes democráticos escapam.

Já viste a gravidade das irregularidades na TAP e respectivo encobrimento pelos responsáveis quer do modelo hierárquico empresarial, quer a nível ministerial e é o fim do mundo. Deixas de ter escrutínio, e deixas de ter controlo e nunca chegas sequer a saber. E assim acaba qualquer regime democrático.

O perigo representado pela AI não é o de máquinas a controlar os humanos como vês/lês na sci-fi, o perigo é colocares meia dúzia de humanos a controlar a humanidade.

Eu disse a quem compete controlar as IAs é aos seres humanos, não disse que não existe um monte deles que não o fazem ou fazem-no em prol dos seus próprios interesses, sobrepondo a sua liberdade à liberdade dos outros.

Tanto a tua resposta como a minha afirmação constatam o principal: Quem está a dar cabo de tudo somos nós, humanos.

Claro que estamos de acordo. No fundo o que ambos estamos a dizer é que:

Informação é poder, e dinheiro é poder.

E o poder corrompe.

A situação insustentável é que por um lado não é possível anular uma tecnologia depois dela ter sido inventada, pois se uns Estados não fizerem uso dela mas os vizinhos fizerem, ficam em desvantagem no equilíbrio dos jogos de poder. E por outro lado, ao usar-se esta tecnologia abriu-se uma Caixa de Pandora…

Na minha opinião isto deixou de ser controlável. É que é ainda menos controlável do que as armas nucleares pois essas deixam rasto e requerem silos ou um número limitado de submarinos, e com isso conseguiu-se estabelecer-se tratados de não proliferação e protocolos como o MAD.

Mas com a AI é diferente.

Não é que sejamos ingénuos, já há décadas que algumas nações têm a capacidade de gravar todas as comunicações de um país num espaço temporal de 3 dias, mas isso serve de ferramenta de mitigação e/ou prevenção.

Agora a AI é uma ferramenta de controlo de massas…

Quem está no poder vai usar todos os mecanismos que tiver ao seu alcance para se manter no poder.

A tua frase “Quem está a dar cabo de tudo somos nós, humanos” é em si uma Preposição Verdadeira, na medida em que não somos individualmente responsáveis, mas sim globalmente, através de quem mandatamos para nos representar, seja através de sufrágio universal nos países democráticos, seja através de imposição militar nos países não democráticos…

Vou lançar uma pergunta, e sem intenção de consubstanciar qualquer rasteira: como controlar, limitar ou circunscrever a AI a nível mundial?

IA não existe e está longe de existir! Todos os actuais sistemas são machine lerning.

AI (IA) – são modelos pré-treinados (“machine learning”) para realizar tarefas específicas

AGI (artificial general intelligence) – em tese, poderá compreender ou aprender, por si, qualquer tarefa intelectual dos humanos.

O que dizes confunde AI com AGI que vem (não muito) longe.

Entre a Inteligência Artificial e a estupidez natural o Musk já fez a escolha dele.

Deve de ter sido por estar tão preocupado com os perigos que fundou agora a X.AI

É muito simples! A dele irá ser 100% segura e fiável #sqn

100% correcto.