Anthropic acusa rivais chinesas de roubo massivo de dados do seu chatbot Claude

A empresa norte-americana Anthropic está a acusar três empresas chinesas de extraírem informações do seu chatbot de Inteligência Artificial (IA), o Claude.

Esta segunda-feira, a Anthropic anunciou que as empresas chinesas DeepSeek, Moonshot AI e MiniMax extraíram ilícita e sistematicamente capacidades do seu chatbot Claude, num alegado caso de roubo de propriedade intelectual à escala industrial.

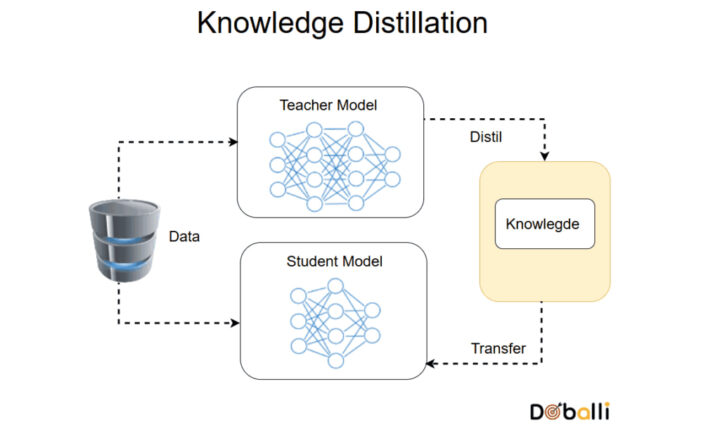

Segundo a Anthropic, as três empresas chinesas de IA terão recorrido a uma técnica conhecida como "distillation", que consiste em usar os resultados de um modelo de IA mais poderoso para aumentar rapidamente o desempenho de outro menos capaz.

Anthropic alega 16 milhões de interações e 24 mil contas falsas

Conhecida, também, como "knowledge distillation", esta prática é comum no desenvolvimento de IA, frequentemente usada por empresas para criar versões mais pequenas e económicas dos seus próprios modelos.

A abordagem ganhou destaque no ano passado, quando o lançamento de um modelo de IA generativa de baixo custo da DeepSeek teve desempenho semelhante ao do ChatGPT e de outros chatbots norte-americanos.

Estas campanhas estão a crescer em intensidade e sofisticação. O tempo para agir é limitado.

Disse a Anthropic, num comunicado, citado pelo The Guardian, informando que as empresas conseguiram atingir os seus objetivos através de aproximadamente 16 milhões de interações com o modelo Claude e 24.000 contas falsas.

Um modelo grande e complexo (o professor) transfere o seu conhecimento para um modelo mais pequeno e mais eficiente (o aluno).

De acordo com a empresa de IA norte-americana, a maior operação foi conduzida pela MiniMax, com mais de 13 milhões de interações. Além disso, cada campanha ter-se-á focado intensamente em programação, agentic reasoning e utilização de ferramentas, áreas em que o Claude é considerado líder.

Desta forma, as três empresas terão conseguido adquirir capacidades que não tinham desenvolvido de forma independente por uma fracção do custo, contornando os controlos de exportação sobre tecnologia avançada dos Estados Unidos destinados a preservar o seu domínio em matéria de IA.

Para a Anthropic, a prática representa riscos para a segurança nacional, pois modelos construídos através de "distillation" são pouco propensos a manter salvaguardas de segurança concebidas para prevenir o uso indevido, como restrições no auxílio ao desenvolvimento de armas biológicas ou à realização de ciberataques.

Anthropic, não era francesa ?

Tenho procurado usar pois de facto já comprovei que tèm algoritmos feitos com mais cuidado, mas pode ser impressão, vai um artigo de comparação bem estruturado

Não estás a confundir com a Mistral?

A Antrophic é uma empresa americana com sede em São Francisco. O seu modelo de LLM chama-se Claude em homenagem Claude Shannon, um pioneiro em inteligência artificial.

chineses, sempre a trapacear…

Só eles, mais ninguem o faz quer ver??

Eles, os russos e os norte-coreanos. Enfim, todo lixo deste mundo.

Tem piada, como se o Claude e outros modelos não se alimentaram de conteúdo que está público para serem treinados.

Em vez de reclamarem que lancem, eles próprios, modelos mais leves e que possam ser usados em dispositivos menos potentes

Como se eles não utilizassem conteúdo que não lhes pertence, para alimentar os sugadores de energia e de recursos, que têm.

Destilação não é roubo de propriedade intelectual. Até porque as próprias IA do ocidente o fazem. Mas pronto… Estas empresas estão claramente desesperadas com os rápidos avanços dos modelos chineses, que tudo serve de desculpa para acusar roubo de propriedade intelectual.