Vencedor do Prémio Nobel da Física abandonou a Google para avisar sobre o perigo da IA

Desde a integração de Inteligência Artificial (IA) em novos sistemas e aplicações, muitos têm sido os avisos sobre o seu potencial impacto. Um destes partiu do agora Prémio Nobel da Física, que abandonou a Google para alertar sobre o perigo que a tecnologia representa.

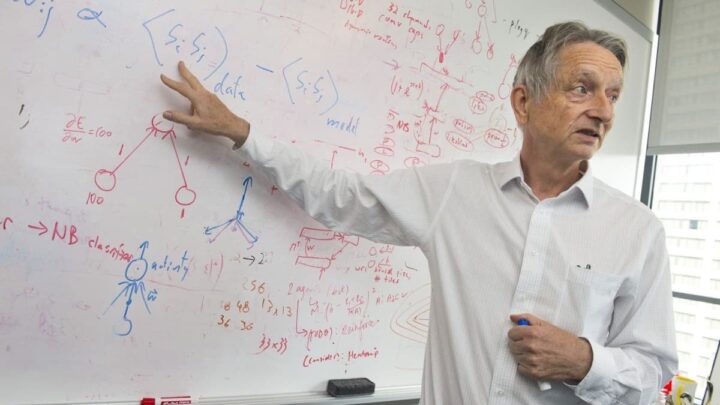

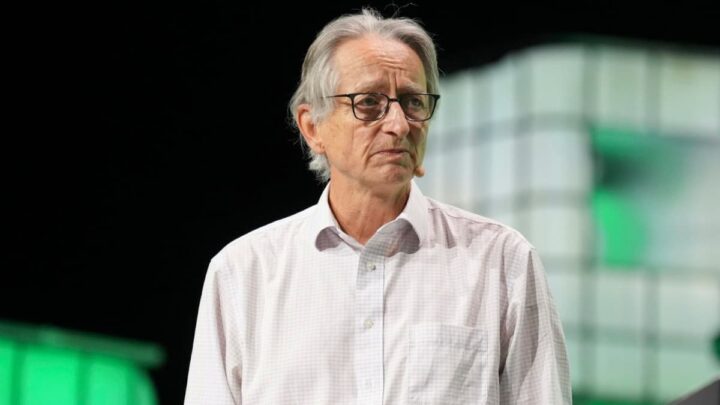

Esta semana, o físico americano John Hopfield e o especialista em IA Geoffrey Hinton receberam o Prémio Nobel da Física, num reconhecimento pelo trabalho desenvolvido na criação de redes neurais artificiais, inspiradas no cérebro humano, que fazem com que as máquinas consigam aprender.

Considerado o "padrinho" da IA, Geoffrey Hinton abandonou o seu cargo de vice-presidente e o seu trabalho enquanto engenheiro na Google, em 2023, para integrar a lista de vozes que tem alertado sobre o perigo da tecnologia. O especialista lançou, em 2012, as bases para as atuais redes neuronais.

In the NYT today, Cade Metz implies that I left Google so that I could criticize Google. Actually, I left so that I could talk about the dangers of AI without considering how this impacts Google. Google has acted very responsibly.

— Geoffrey Hinton (@geoffreyhinton) May 1, 2023

No ano passado, numa entrevista conduzida pelo The New York Times, Geoffrey Hinton disse que, anteriormente, pensava na Google como um "administrador adequado" da poderosa tecnologia. Esta perspetiva durou até a Microsoft ter estabelecido uma parceria com a OpenAI para lançar o GPT-4, que alimenta o ChatGPT, para as massas.

"Gostava de ter uma espécie de receita simples" para a IA, disse Hinton

Conforme informámos, na mesma entrevista, Hinton revelou ter fortes receios de que a IA se torne num risco para a própria humanidade.

Na altura, admitiu que os chatbots mais avançados "ainda não são mais inteligentes do que nós, mas penso que em breve poderão vir a sê-lo". Nesse momento, o cientista informático de 76 anos não considerava que a IA estava no seu apogeu. Contudo, não viu o acordo entre a Microsoft e a OpenAI com bons olhos.

A maioria das pessoas achava que estava muito longe. E eu achei que estava muito longe. Pensava que faltavam 30 a 50 anos ou até mais. Obviamente, á não penso assim.

Disse, na entrevista.

Antes de deixar a Google e de assinar uma carta, juntamente com outras personalidades, a pedir uma pausa no desenvolvimento da IA, o informático foi à CBS News avisar que o mundo tinha chegado a um "momento crucial" em termos de tecnologia.

Penso que é muito razoável que as pessoas se preocupem com estas questões agora. Mesmo que isso não vá acontecer no próximo ano ou dois.

Durante uma conversa com o comité do Prémio Nobel, o agora professor emérito da Universidade de Toronto, partilhou que pensa que a IA pode escapar ao controlo humano a qualquer momento e que isso pode ser o fim do mundo.

Estamos a lidar com algo em que temos muito menos ideia do que vai acontecer e do que fazer. Gostava de ter uma espécie de receita simples que dissesse que, se fizermos isto, tudo vai correr bem. Mas não tenho.

Sobre o Prémio Nobel da Física, que ganhou esta semana, Geoffrey Hinton revelou que espera que o "torne mais credível".

Este artigo tem mais de um ano

Estamos pela primeira vez a experiência algo que pode acabar com a humanidade sem que a grande maioria das pessoas se aperceba disso, Na 1º ou 2º Guerra mundial toda a gente tinha plena consciência que podia dar para o torto agora a maioria das pessoas nem sabe o potencial da IA

Já se fala que atualmente estamos numa 3ª Guerra, repara que muitas vezes (especialmente EUA) usam IA para atacar território “inimigo”…

Diria que já estamos no inicio do primeiro passo para o caos geral…

Se há coisa que as história nos ensina é que somos cobaias das nossas proprias experiencias, muitos sofrerão outros morrem outros ficam para trás, o progresso deixa todo um rasto de lágrimas e sangue.

pela primeira vez desde o início da humanidade, há algo no planete mais inteligente do que o ser humano … além do receio com isso, acho que também não estamos preparados para lidar com esta situação de inferioridade 🙁

Se há uma coisa que a IA não é de momento é inteligente! Tem muito conhecimento e muita saberia acumulada com todo esse conhecimento. Mas diz e faz muita coisa pouco inteligente. Sei do que falo pois trabalho com ela diariamente.

Agora se conseguirem melhorar o raciocínio e a inteligencia da IA, poderá no futuro ser mais inteligente que o ser humano… mas ainda está longe disso!

+1

Isso pode ser válido agora. Dá-lhe mais uns anos.

Foi o que eu disse!!!

Não está assim tão longe. 1-2 anos.

1-2 anos duvido muito!

Em termos de capacidade de informação e conhecimento já ultrapassou há muito a de um ser humano! Falta mesmo o raciocinio, inteligência e discernimento. MAS não confundir inteligencia com conhecimento!

Os especialistas que tenho ouvido são unanimes a dizer que estes modelos revolucionários são muito bons em “conhecimento” prevendo respostas baseadas em texto já existente.

Estes modelos estão basicamente a prever qual será a próxima palavra baseada nos milhões de texto de onde aprenderam. De inteligente este método tem muito pouco.

Um dos especialistas desta area que ouvi, até afirmou que este método das LLM será limitado e não será com ele que se chegará a uma inteligencia superior á humana.

Dito isto com avanços nos modelos de LLM e com a integração de outros modelos de IA acredito que a IA poderá superar a inteligencia humana. Mas não será certamente em 1 ou 2 anos! Disso tenho a certeza.

+1

concordo completamente que de inteligência não tem nada! Apesar de “boom” do chatgpt transformar estas plataformas mais comerciais, especialmente a palavra IA, elas já por aqui andam a alguns anos, evoluindo bastante durante os últimos anos. No entanto tem sido encontrados alguns problemas com os modelos, o que não me leva a acreditar em uma evolução muito grande em 1-2 anos..

O que eu odeio nestas notícias é a forma como evitam os porquês. Porquê que a IA pode ser perigosa? O contexto importa bastante mas ir na onda da SkyNet vai dominar tudo e começar a abater-nós da mais cliques, nem jornais de nome resistem…

A IA tem os seus quês, sem dúvida mas também tem sido uma grande ajuda em certas áreas. A saúde é uma delas. Deteção de cancro anos antes, por exemplo, é um grande avanço.

Agora isto é como qualquer “arma”, pode ser um auxílio ou usada para o caos

É um ponto importante, não há dúvida.

Creio que o ser humano tem tendência a olhar às coisas pela lado negativo em vez do positivo.

Mas é o que mencionas também e com razão, a IA pode ser uma ferramenta utilizada para o bem como uma arma utilizada para o caos..

Felizmente ou infelizmente, essa decisão é do ser humano, o ser egoista e invejoso que não se contenta com o que tem.

A IA é uma ferramenta como um martelo que para por pregos e na construção é importantíssimo no entanto também pode ser usado para o mal normalmente o ser humano tem mais tendência a olhar para o lado negativo da coisa porque o lado positivo muita gente nem imagina onde pode chegar

Hinton: “No NYT de hoje, Cade Metz insinua que eu deixei o Google para poder criticar o Google. Na verdade, eu saí para poder falar sobre os perigos da IA sem considerar como isso afeta o Google. O Google agiu de forma muito responsável.2

Questão que lhe colocaram: “Originalmente previu que a IA se tornaria mais inteligente do que um humano em 30-50 anos. Agora diz que isso vai acontecer muito mais cedo. Em quanto tempo?”

Resposta: “Agora prevejo de 5 a 20 anos, mas sem muita confiança. Vivemos em tempos muito incertos. É possível que eu esteja totalmente errado sobre a inteligência digital nos ultrapassar. Ninguém sabe realmente, e é por que nos devemos preocupar agora”.

Os capitalistas contam com a IA para substituir em massa trabalhadores e aumentar em flecha o desemprego. Desse modo metem ao bolso os salários e criam um enorme exército industrial de reserva capaz de anular os sindicatos e dar-lhes a supremacia total sobre o trabalho. O único problema é que eles não säo suficientemente inteligentes para fazer a manutenção da IA, quanto mais para a produzir.

Tens toda a razão,até porque no teu pais comunista amado,China, o ping nem ordenou o desenvolvimento de robots para operar em fábricas

Segundo estes novos benchmarks ( predecessores da AGI), muito difíceis e que já exploram as capacidades da AI em 3D do mundo real, o ultimo modelo da openai fica a baixo das expectativas, mas muito acima da concorrência e restante opensource: Publico o resultado do bench mas podem ver este video antes menos maçador: https://www.youtube.com/watch?v=FDrLWjLxBFw

e o bench :https://www.reddit.com/r/LocalLLaMA/comments/1g0r6kw/new_agent_bench_from_oa_tested_on_openhands_mlab/

A “safa” da Humanidade é que o cérebro humano sai por vezes fora da lógica e, para o melhor ou pior, teve-tem atitudes-ideias-criações que empurraram o ser humano para a frente, algumas para trás que mais cedo ou mais tarde ficaram muito à frente. Não estou a ver a IA a ter respostas fora da lógica matemática 🙂 Mas…parece-me que a IA surge porque a inteligência humana está cada vez mais imbecil para a própria sobrevivência 🙂 E como muitos exemplos o criador sucumbe à sua criação 🙂

Pode ser que a bolha da IA rebente e acalme por uns tempos o seu avanço.

https://medium.com/predict/openai-is-about-to-make-the-ai-bubble-a-you-problem-0c6e945742f6