OpenAI recheia a sua API: acrescenta o modelo o1-pro e dois novos modelos de áudio

Muito em breve, será difícil acompanhar a quantidade de modelos que a OpenAI disponibiliza na sua API, e isso é certamente uma boa notícia. A empresa continua a liderar a revolução da inteligência artificial (IA) e, recentemente, voltou a surpreender ao acrescentar o o1-pro, um dos modelos mais caros da sua história, e dois novos modelos de áudio à sua API.

o1-pro chega à API da OpenAI

De acordo com a gigante de IA, o o1-pro é um dos modelos mais avançados até à data, o que naturalmente se traduz num aumento significativo dos custos operacionais. O o1-pro requer um volume de recursos muito superior ao do modelo default, mas oferece respostas mais consistentes e precisas.

No entanto, a sua disponibilidade é, para já, bastante restrita, sendo acessível apenas a um grupo selecionado de programadores.

Diferenças de preço bastante acentuadas

A OpenAI cobra 150 dólares por milhão de tokens introduzidos no modelo (aproximadamente 750.000 palavras) e outros 600 dólares por milhão de tokens gerados. Em termos comparativos, trata-se do dobro do custo do GPT-4 e de um valor dez vezes superior ao do o1 default.

No entanto, não está claro se o o1-pro é realmente dez vezes mais poderoso do que o o1 default para justificar esse aumento de preço. As primeiras impressões dos utilizadores que tiveram acesso antecipado através do programa Pro da OpenAI foram mistas. Segundo o TechCrunch, o modelo demonstrou dificuldades em resolver desafios como sudokus e ilusões óticas.

Aliás, as análises internas da OpenAI realizadas no final do ano passado indicaram que o desempenho do o1-pro era apenas ligeiramente superior ao do modelo default em tarefas de coding e matemática. O preço elevado parece estar mais relacionado com o aumento da exigência computacional do modelo do que com uma melhoria drástica na sua capacidade.

Novos modelos de voz de última geração para o ChatGPT

O que é realmente entusiasmante neste anúncio são os novos modelos de áudio que a OpenAI revelou. A empresa lançou dois novos sistemas de reconhecimento e síntese de voz através da API, tornando a IA por voz mais avançada, personalizável e eficaz.

Estes modelos destacam-se pela sua capacidade de lidar com diversas pronúncias, ambientes ruidosos e diferentes velocidades de discurso.

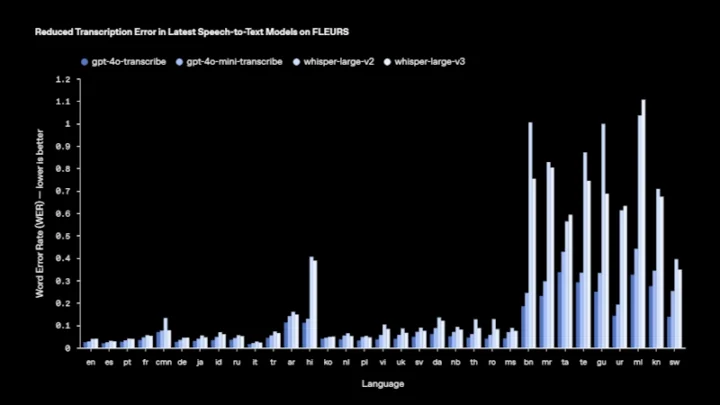

Os novos modelos, denominados gpt-4o-transcribe e gpt-4o-mini-transcribe, apresentam melhorias significativas na taxa de erro de reconhecimento de palavras, assim como uma maior precisão na identificação do idioma.

Em relação aos modelos Whisper anteriores, estes novos sistemas conseguem captar melhor os subtis detalhes da fala, reduzir erros de transcrição e aumentar a fiabilidade geral das respostas.

Tal como acontece com outros serviços da OpenAI, o preço de utilização destes modelos varia conforme a versão escolhida. Para o gpt-4o-transcribe, o custo é de 6 dólares por milhão de tokens de input de áudio, 2,50 dólares por milhão de tokens de input de texto e 10 dólares por milhão de tokens gerados.

No caso do gpt-4o-mini, os valores são mais acessíveis: 3 dólares por milhão de tokens de áudio de input, 1,25 dólares por milhão de tokens de input de texto e 5 dólares por milhão de tokens gerados.

Com estes lançamentos, a OpenAI reforça a sua posição de líder no mercado de APIs de IA.

Leia também:

Este artigo tem mais de um ano