E se um robô violar as leis da robótica?

O mundo da robótica tem evoluído em várias vertentes. Segundo alguns estudos, os robôs serão tão inteligentes como os humanos em 2029, altura em que poderá ser possível comparar a inteligência artificial à mente humana.

Mas e se um robô violar as leis da robótica?

O escritor russo Isaac Asimov ajudou, com os seus escritos ficcionistas revolucionários, a definir uma nova visão dos robôs. Durante anos, as leis do autor de ficção científica, imortalizadas na sua obra, foram consideradas suficientes entre os entusiastas dos robôs. As leis em si, são simples (pouco abrangentes para os dias de hoje):

- Lei 1: Um robô não pode causar danos a um ser humano ou deixar que algum ser humano se magoe.

- Lei 2: Um robô tem de obedecer a ordens dadas por um ser humano, excepto quando essas ordens entram em conflito com a Primeira Lei.

- Lei 3: Um robô tem de proteger a sua própria existência desde que não entre em conflito com a Primeira ou Segunda Lei.

- Lei Zero (criada posteriormente, por um robô que a intuiu no romance “Os Robôs e o Império”): Um robô não pode causar mal a humanidade ou, por omissão, permitir que a humanidade sofra algum mal, nem permitir que ela própria o faça.

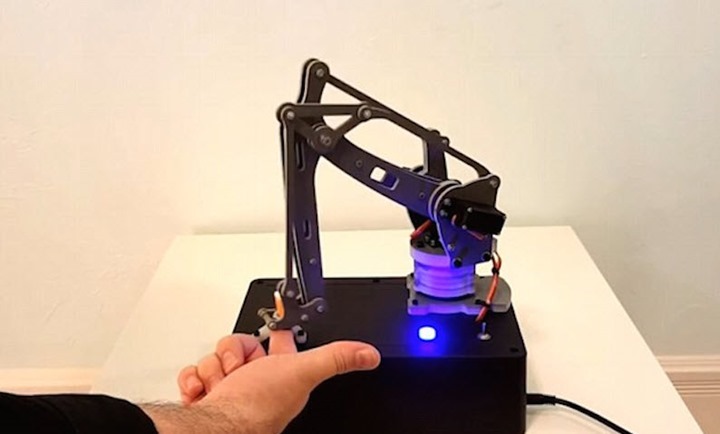

Alexander Reben, Engenheiro na Universidade de Berkeley, criou um robô para alertar para os problemas que podem advir da robótica quando há um desenvolvimento sem responsabilidade. Como podemos ver pelo vídeo seguinte, a primeira lei é violada.

O robô foi programado para “picar” o dedo do ser humano mas nem sempre, dando assim a liberdade da máquina fazer o que entender num determinado momento. Num documento académico, o investigador expõe a sua visão sobre o futuro destas máquinas inteligentes e também possíveis soluções para a intervenção em segurança das mesmas.

Como acha que será o mundo dos humanos onde haverá cada vez mais máquinas inteligentes?

Este artigo tem mais de um ano

Como é que as leis são pouco abrangentes para o dias de hoje?

Imagine-se um carro autónomo, onde não é preciso intervenção humana. Você está dentro do carro descansado. De repente o carro despista-se e vai de encontro a um grupo de pessoas. O carro consegue desviar-se da multidão, mas para isso põe em risco a sua vida. Que decisão o carro deve tomar? Continuar na direção da multidão ou desviar-se.

Deixo o seguinte artigo que explora este tema: https://www.wired.com/2016/06/people-want-self-driving-cars-save-lives-especially/

A vida do condutor visto que é o consumidor. A decisão nunca vai ser algo diferente visto que ninguem compraria um carro que ponha a vida do condutor abaixo dos outros.

As leis foram feitas para ser quebradas

O taxista também dizia quem sim, mas com uma analogia mais requintada!

Se um robot viola ou não as leis da robótica, isso não sei, mas que um computador viola as leis da computação, isso é constante.

Que leis da computação?

Principalmente as Leis das Ordens Humanas.

Recusam-se a fazer o que lhes ordenamos, e apenas o fazem (quando o fazem) se lhes apetecer.

Compra um SSD e acaba lá com esse choro, o problema está em ti não na máquina.

Não sei se te apercebeste, mas estás-te a contradizer.

Muitas vezes há coisas que não fazem sentido. 😉

Mais umas “leis” que desconheço… foste tu que as criaste?

A legislação não se restringe 3 ou 4 leis. Desde há cerca de 50 anos que existem normas a regrar o fabrico e utilização de máquinas -robôs incluidos, e que impedem a saída para o mercado de produtos não conformes. A Directiva Máquinas regula actualmente todo o leque de automatismos.

Por outro lado não esqueçamos que a legislação nesta área caminha quase sempre a par das inovações que vão surgindo, trancando saídas de rota imprevistas antes.

Já a humanidade, é incontrolável… o que resultou na bomba atómica teve uma raiz benfeitora…

esse vídeo é ridículo, o robô claramente foi programado para fazer aquela função se meteu la o dedo é culpa da pessoa.

Claro. Aquele video não prova nada.

Prova que as ditas leis não existem excepto na imaginação de autores de ficção cientifica.

Quando e se conseguirmos programar uma IA talvez se possa pensar nisso, por agora é só mesmo ficção cientifica.

A ideia que a inteligencia artificial terá consciencia ainda é uma noção sci-fi que não vai existir na pratica, o comportamento dos robos é ditado por quem os programa, conforme o programa implementado assim será o comportamento e será totalmente previsivel ao contrário do ser humano, pode ocasionalmente acontecer acidentes que farão vitimas humanas devido a um programa mal feito por erro humano, caso isto aconteça e os responsaveis não assumirem a responsabilidades ai sim teremos as culpas em cima da inteligencia artificial e será oficialmente o “nascimento” dessa inteligencia! fazer de conta que a inteligencia artificial terá consciencia vai ser conveniente para muito criminoso do capital se safar.

Que parvoíce!

As ditas leis da robótica não são mais que leis criadas por humanos. As máquinas apenas seguem a sua programação ou o seu código fonte.

Portanto se alguém programar um robot para fazer uma acção que cause danos a um humano ela executa essa acção. Não sabe nem tem maneira de saber interpretar “leis”.

Estamos muito longe ainda de ter robots com inteligência artificial. E mesmo nessa altura não será impossível que violem as ditas regras.

Claro que um robô pode violar as leis… Se elas não forem implementadas no sistema.

Quem e que me diz que esse senhor implementou as leis de forma que antes de cada acção, o robô, verificasse se não entrava em conflito com as leis existentes?

É o próprio Isaac Asimov, nomeadamente nos seus excelentes contos “First Law” e “Runaround” a mostrar que as por si concebidas leis da robótica podem ser conflituosas.

No primeiro dos referidos contos, o robô tinha poderes para conceber e criar outros robôs. Numa incursão numa das luas de Saturno, o robô pai, numa ternurenta manifestação de paternalismo, preocupou-se mais em salvar um robô filho, ou seja, manter a prole, do que proteger o humano que também se encontrava em perigo ( a prole não estava contemplada nas leis da robótica ).

No segundo dos contos o robô tinha sido programado e concebido para executar tarefas perigosas para o que foi reforçada a Terceira Lei no sentido de proteger o robô para quando a tarefa a executar implicasse a destruição deste. Foi o que aconteceu em Mercúrio nas imediações de um lago de selénio que seria letal para o robô, o que fez este deambular em “loops” ao redor do lago como que embriagado e a única maneira de o trazer de regresso à nave foi o humano sair desta e arriscar a sua vida para ditar uma ordem fazendo prevalecer a Primeira e Segunda Leis.

De referir que Isaac Asimov, embora nascido em território da União Soviética, emigrou aos três anos de idade com a sua família judaica-idiche para os EUA, país este onde fez toda a formação e carreira académica de professor e escritor ( mais de quinhentas novelas ) tendo adquirido a nacionalidade americana. Fez um pacto com Arthur C. Clark no sentido que este o trataria por escritor de ciência e, em contrapartida, Arthur C. Clark seria tratado por aquele como escritor de ficção científica, pacto este que só os dois respeitaram, não os leitores que têm ambos e também Heinlein como os maiores prodígios da ficção científica.

Quanto às implicações de um futuro mundo exponencialmente dotado de máquinas inteligentes e robôs, isto se entretanto a raça humana não estiver já extinta face à progressiva destruição dos “habitats” ou à emergência de um conflito nuclear deixando o planeta moribundo sob o consequente inverno nuclear, eventos estes por acção do ser humano que recentemente passou a dispor do poder de se auto-extinguir, tal profusão de robótica e IA inevitavelmente conduzir a uma nova revolução industrial tendo por uma das consequências o regresso ou repatriamento das empresas aos países do respectivo “know how” e capital que superaria não só o tempo de produção ( 24 horas) mas também os custos.

Poderia aproximar-se muito, na sua visão mais optimista, do previsto na obra do recentemente falecido futurólogo Alvin Toffler, especialmente nos seus livros “Future Shock” e “The Third Wave” e, note-se, tais obras foram escritas nos anos oitenta do século passado.

O grande problema a resolver desta nova revolução industrial seria o de como superar ou conciliar o chamado “desemprego tecnológico” do humano e como se faria a redistribuição dos rendimentos. Na verdade, num mundo onde já hoje nos deparamos com produção 24 H em linha robotizada, caixas multibanco, portagens automáticas e demais exemplos, o que sobraria para o comum dos humanos poder sobreviver num mundo previsivelmente superpovoado e cuja produção seria assegurada maioritariamente por robôs ?

É que, num mundo robotizado já não se aplica a Lei de Say segundo a qual o produto gera o seu próprio rendimento ( para poder comprar o produto ).

Também a configuração dos estados-nações, face à superveniência dos problemas de sobrevivência da maioria da população mundial , teria de ser repensada em torno de um governo mundializado, e foi o desacompanhamento deste em relação a uma desequilibrada globalização económica que muito contribuiu para o actual estado de degradação dos “habitat” naturais. Já existem sítios onde, para sobrevivência, se pesca com recurso a explosivos !!

.

Estas leis não se aplicam propriamente a robots dado que eles são programados para realizar uma tarefa. Fazem mais sentido quando existir uma inteligência verdadeiramente artificial

Um mundo onde houver cada vez mais máquinas inteligentes é um mundo onde também haverá cada vez menos humanidade, isto claro se essas máquinas tiverem mesmo uma inteligência artificial.

World War III: Humans vs machines. Cada vez mais perto.

Os robôs/inteligências artificiais serão tão inteligentes como os humanos? Ok, basta ir por aí para se saber que as regras/leis/princípios serão quebradas pelos robôs visto que os humanos quebram todas as leis e mais algumas. Quando chegarem ao nosso nível de inteligência (ou falta dela) serão tão obtusos quanto nós.

E os robôs/inteligências artificiais irão com certeza tratar de subjugar os humanos, isto é mais do que óbvio. Primeiro qualquer ser inteligente vê que a raça humana é uma tremenda ameaça à sobrevivência do planeta e as ameaças são para serem eliminadas; e segundo só pode haver uma raça dominante, os robôs/inteligências artificiais irão garantidamente querer ocupar essa posição.

Curiosidade: não era no filme “Exterminador Implacável 2” que estava um aviso sobre o 11 de Setembro dez anos antes dele acontecer? http://3.bp.blogspot.com/-ufw_WjoHwRE/T2cGwZnkfWI/AAAAAAAACHc/eC9rbmEKiac/s1600/caution-9-11.jpg

A série de filmes d’O Exterminador Implacável é bem capaz de ser ela também uma previsão acertada do futuro.

Mas não há qualquer problema, antes ser morto por um robô em poucos segundos do que andar meses ou anos a morrer com um cancro criado pelo homem e a sofrer que nem um cão moribundo. Por isso tragam os robôs, serão com certeza mais humanos do que os homens! 😀

Ja tinha visto isto das “leis” no filme i-robot onde entra o ator Will Smith

Povo, vamos a ver se entendemos uma coisa:

As leis da robótica não funcionam e nunca funcionaram. Elas são obra de ficção, não são levadas a sério por ninguém que realmente trabalhe com robótica.

Vídeo acerca do assunto: https://www.youtube.com/watch?v=7PKx3kS7f4A

Não teria de haver mais uma lei a impedir os robots de se auto programarem para assim evitar que eles modifiquem as leis existentes?

Parece haver muita gente a confundir estas ditas leis com a programação (IA) das maquinas.

É claro que estas ou quaisquer outras leis/instruções têm que ser programadas pelos humanos aquando da criação dessas mesmas maquinas. Algo deste genero.

1- Receber ordem

2- a ordem vai incidir sobre que/quem?

2.1- é humano?

2.1.1 – Se sim, chamar função leisBasicas

2.2- leisBasicas = false executar acção, senão não executar

É lógico que o robot do video não foi programado para funcionar assim, nem parece ter a capacidade para perceber que vai picar um dedo humano, quanto mais para verificar se pode ou não magoar