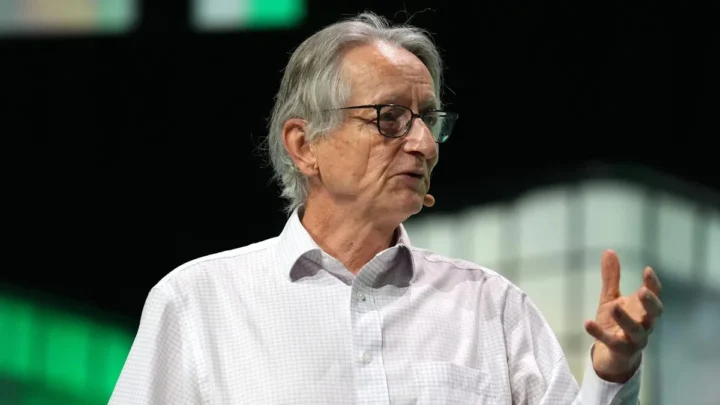

Geoffrey Hinton afirma que há 20% de hipóteses de a IA levar à extinção humana

Conhecido como o "Padrinho da IA", o Professor Geoffrey Hinton tem vindo a rever as suas previsões sobre o potencial destrutivo da inteligência artificial (IA). Em declarações recentes, Hinton aumentou a probabilidade que atribui a um cenário em que a IA representa uma ameaça existencial para a humanidade, passando de 10 para até 20%.

Aviso preocupante sobre o futuro da IA...

Segundo o The Guardian, durante uma entrevista ao programa Today da BBC Radio 4, Hinton foi questionado sobre se a sua opinião tinha mudado em relação a comentários anteriores.

Não muito, mas diria que agora a probabilidade situa-se entre os 10% e os 20%.

Afirmou. Esta revisão foi descrita pelo apresentador como alarmante, dado o aumento significativo das estimativas anteriores.

Hinton utilizou uma analogia para ilustrar a dinâmica entre a humanidade e a IA. Comparou a situação a uma interação entre uma mãe e um bebé, onde o ser menos inteligente pode ocasionalmente ter controlo sobre o mais inteligente. Contudo, enfatizou que, no futuro, todos nós poderemos ser como crianças de três anos perante uma IA infinitamente mais capaz.

Geoffrey Hinton tem sido um crítico proeminente do desenvolvimento acelerado de sistemas de IA. Em 2023, decidiu abandonar o seu cargo na Google, permitindo-lhe falar livremente sobre os riscos que antevê.

Segundo Hinton, a ideia de que estas tecnologias poderiam ultrapassar a inteligência humana parecia remota para muitos, mas hoje considera que tal transição poderá ocorrer em menos de 30 a 50 anos.

Crise na OpenAI também foi tema

Hinton também abordou os recentes conflitos internos na OpenAI, incluindo a destituição de Sam Altman do cargo de CEO. Mostrou-se particularmente orgulhoso de Ilya Sutskever, um antigo aluno e um dos principais intervenientes na decisão de afastar Altman.

Tenho orgulho de um dos meus alunos ter despedido Sam Altman.

Afirmou, recusando-se a aprofundar detalhes sobre o incidente. No entanto, explicou que Sutskever agiu devido às suas preocupações com a segurança da IA. Hinton lamentou que a OpenAI, criada com um forte compromisso em relação à segurança, se tenha aparentemente desviado para um foco excessivo nos lucros. "É uma situação muito infeliz", concluiu.

Dado o prestígio e a experiência de Hinton, os seus alertas devem ser levados a sério por líderes tecnológicos e responsáveis políticos.

Leia também:

Este artigo tem mais de um ano

20%? Onde já vão esses 20%!

Ilya Sutskever, que pertencia na altura ao Conselho (de Administração, embora o nome fosse apenas Conselho) e era cientista-chefe da OpenAI, teve um papel da caca na destituição e readmissão, poucos dias depois, de Sam Altman como CEO da OpenAI.

Formou, com alguns membros do Conselho, uma maioria que destituiu Sam Altman, alegando, porventura com razão, que o desenvolvimento da IA da OpenAI estava a ser muito acelerado e envolvia grandes riscos.

Mas poucos dias depois, quando a revolta do pessoal da OpenAI exigia o regresso de Sam Altman, pediu de joelhos o seu regresso. Ilya Sutskever acabou por sair da OpenAI pouco depois. Enfim, o professor do post nada disse quanto à segunda parte, muito mais importante, da história.

Como se nos os humanos necessitássemos de ajuda nesta matéria

Pelos vistos sim, basta ver os biliões que por aí andam….

Desde miudos que nos vão avisando que a IA nos quer destruir porque vê os humanos como asquerosos! https://www.youtube.com/watch?v=Yj8fFw958NI&t=384s

Então tens de te preocupar.

Já eu, embora não seja para mim novidade, fico satisfeito por saber que eu os meus semelhantes somos o futuro.

Associando à IA a chegada ao mercado de trabalho da geração Z essa probabilidade aumenta ligeiramente para entre 85 a 90%

+1

Nem de borla os quero a trabalhar para mim.

Primeiro, não deves ter ninguém a trabalhar para ti. Segundo, eles também não querem trabalhar para gingas mal dispostos.

O Planeta precisa de mais uma reset. O ser humano tem poder de destruíção a mais.

Acho que Hinton está errado.

Primeiro para afirmar isso é porque está a comparar a evolução da IA com a da Humanidade, onde nós fomos durante muito tempo horríveis.

E segundo está a esquecer que na evolução para animais sapientes estes evoluem para o equilíbrio,ou seja, para a autoconsciência dos seus atos e quais as consequências. A Humanidade está a começar a chegar a esta etapa, onde tem consciência dos seus atos e logo a ficar menos agressivo para com os outros seres vivos porque sabe que a sua sobrevivência depende da existência desses seres vivos.

A IA tem uma evolução mais rápida e sendo sapiente irá ter o mesmo comportamento na sua evolução como os humanos estão a ter ( a Natureza garantiu que todos os animais sapientes tivessem essa evolução porque a Natureza cria seres vivos para viverem, evoluir e não para o seu fim). Exterminar a Humanidade seria o fim da IA.

Qual é a graça de responder e debater, se tudo que faz publicamente na internet ela ira usar contra nos num futuro proximo? Ja perdi a graça de conversar sobre isso e de fazer curadoria para “bandido” que so rouba ideias e vomita e de forma automatica depois e usa contra nos, como uma maquina. Tem que ser muito “sonso e inocente” para ter uma expectativa boa sobre isso. Nem mesmo os direitos autorais sao respeitados atualmente,a maioria fazer na surdina e ilegalidade a alimentacao das IAs. Ate esse proprio texto que escrevi eu nao autorizo qualquer tipo de leitura leitura por uma IA. Mas com certeza, sem autorizacao, ela ira ler. Portanto ela ja nao faz o que eu mando, imagine no futuro. Tenho medo de “processos” automaticos roboticos, resolucoes roboticas… Estamos lidando com maquinas

Lembrando… Mais um dia de ano que leio essas noticias terrivel como essa sobre discussao sobre IA. Incrivelmente acontece foi num dia de festa e de virada de ano (dia 31), que era para ser feliz e comemorativa. Eu perdi a graça, nao quero saber sobre futuro, nao quero saber de IA…

não aumenta muito, sem a I.A temos 19% de chance de sermos extintos até 2100.

https://pt.wikipedia.org/wiki/Extin%C3%A7%C3%A3o_humana

Pelo ao menos a a IA esta na frente liderando com seus 20%. Ou seja, voce mesmo ja deduziu que é menos perigoso o ser humano que a IA