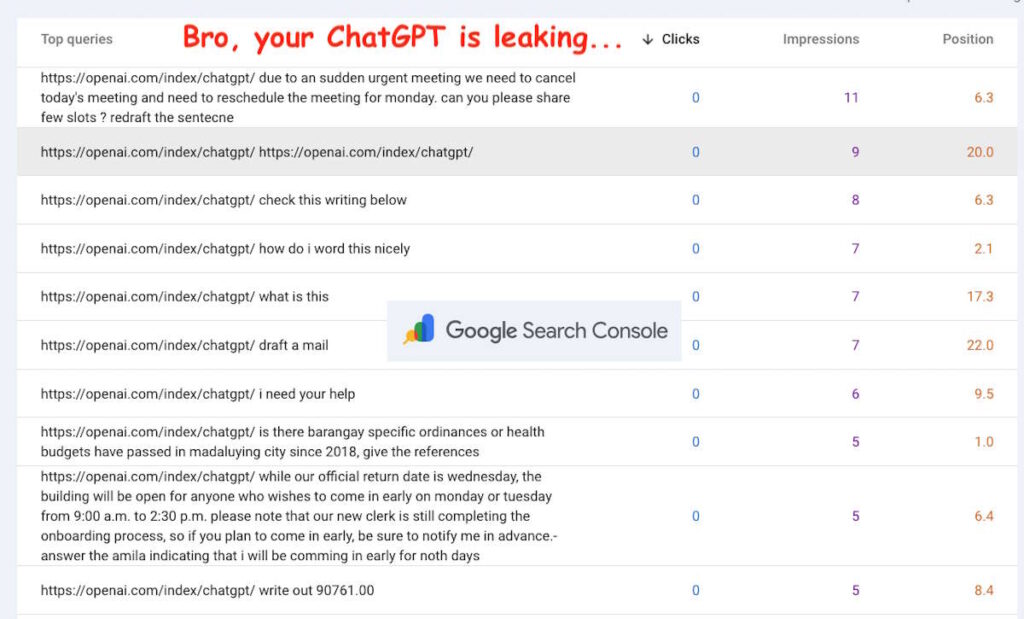

Conversas com o ChatGPT podem ter ficado visíveis para outros utilizadores

Um bug no ChatGPT fez com que algumas consultas e conversas privadas de utilizadores fossem divulgadas para o Google Search Console. O problema já foi corrigido, mas evidencia que a privacidade total não é garantida quando se utilizam chatbots.

Conversas com ChatGPT visíveis para utilizadores

Um novo bug no ChatGPT fez com que certos avisos privados dos utilizadores aparecessem no Google Search Console (GSC). Esta é uma ferramenta que os criadores de sites utilizam para monitorizar o tráfego de pesquisa. Isto permitiu que algumas consultas, originalmente enviadas para o chatbot da OpenAI, ficassem visíveis para outras pessoas com acesso, colocando em risco a privacidade destas conversas.

A OpenAI esclareceu que o problema foi resolvido e apenas afetou um pequeno número de consultas. A empresa explicou que se tratou de um erro técnico que fez com que alguns pedidos fossem enviados acidentalmente para o GSC. Aqui puderam ser visualizados por outros utilizadores.

Alguns especialistas, como Jason Packer, proprietário da consultora Quantable, salientaram que este incidente pode estar relacionado com uma prática da OpenAI. Esta empresa quer de extrair informação do Google para responder a perguntas dos utilizadores.

Falha da OpenAI foi entretanto resolvida

Esta situação faz parte dos problemas de privacidade que os chatbots de IA, incluindo o ChatGPT, têm enfrentado. Contempla desde pedidos legais para históricos completos de conversas até críticas sobre a utilização de dados pessoais.

Qualquer pessoa que utilize o ChatGPT ou outros chatbots de IA deve estar ciente de que as informações partilhadas podem não permanecer privadas. Este erro demonstra que a privacidade total não é garantida ao interagir com estas ferramentas.

O bug já foi corrigido, afetando apenas um pequeno grupo de pessoas, mas serve de alerta para os riscos de privacidade associados à utilização de chatbots com IA. Como tem sido repetidamente recomendado, os dados sensíveis e informações particulares devem ficar longe da IA, Tudo isso serve para proteger os utilizadores.