Visão computacional e tecnologia móvel ajudam cegos a “ver”

Se os smartphones e os tablets têm cada vez mais um poder incrível de processamento, se são dotados de sensores e de software que nos rodeia de forma intimista ao ponto de captar toda a nossa actividade física e social, porque não juntar uma série de parâmetros mais apurados e levar a "visão" a quem não vê?

Nesse sentido, cientistas da computação estão a desenvolver uma nova tecnologia móvel adaptável que poderia permitir que as pessoas cegas e com deficiência visual pudessem "ver" através do seu smartphone ou tablet.

Esta investigação está a ser financiada pela Google Faculty Research Award, que permite a especialistas em visão computorizada e equipamentos de aprendizagem, da Universidade de Lincoln, Reino Unido, possam inserir um sistema de visão inteligente num dispositivo móvel, ajudando, desta forma, as pessoas com problemas de visão a circular de forma autónoma "fora de portas".

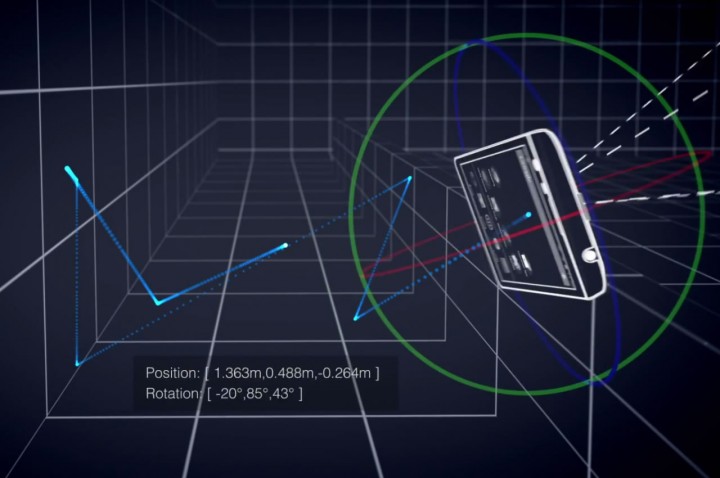

Baseado num trabalho preliminar sobre tecnologias de assistência, desenvolvido no Centro para Sistemas Autónomos de Lincol, a equipa planeia usar cores e tecnologia de sensores de profundidade dentro de smartphones e tablets, como usa o projecto Tango da Google que permite mapear qualquer área onde o sistema aponte num formato tridimensional e geográfico com reconhecimento de objectos. Depois, a equipa irá desenvolver uma interface para interligar toda esta informação lida pelo dispositivo ao utilizador, podendo utilizar vibrações, sinais sonoros ou até palavras recorrendo a um sintetizador de voz.

O projecto, liderado pelo Dr. Nicola Bellotto, um especialista em percepção mecânica e robótica centrada no homem, da Escola de Ciências da Computação de Lincoln referiu que já existem muitos recursos visuais disponível, como pro exemplo os cães-guia, as câmaras e sensores dos wearable. Mas, mesmo existindo todas estas tecnologias, existe também a dificuldade em criar uma verdadeira formula de usabilidade que tenha aceitação no meio que dela necessita.

Se pessoas forem capazes de usar a tecnologia incorporada em dispositivos como smartphones, não será necessário usarem equipamento extra, isso faria com que se sentissem mais auto-conscientes. Além disto tudo, existem aplicações para smartphones capazes de reconhecer objectos ou de converter em voz o local onde geograficamente se encontra o dispositivo. Mas ainda não se tira o proveito total destes sensores que existem no bolso de cada um de nós, pelo menos de forma verdadeiramente útil.

Assim, o objectivo deste projecto é criar um sistema que reúna todas estas tecnologias existentes e possa simplificar de tal ordem os processos que a usabilidade seja enorme e que tudo conjugado torne a vida de quem tem dificuldades visuais muito mais autónoma, simplesmente, tirando proveito de um gadget que para muitos apenas serve para fazer e receber chamadas.

Esta equipa de investigação irá trabalhar com o patrocínio da Google e irá colaborar com especialistas Google ao longo do projecto 'Active Vision with Human-in-the-Loop for the Visually Impaired’.

Este artigo tem mais de um ano

Parabens .me mande noticias trabalho c cegos e surdocegos.